Stable Diffusion 3

综合介绍

Stable Diffusion 3是Stability AI公司最新推出的文本生成图像模型。这个模型能够根据文字描述生成高质量的图片。用户可以通过网页免费使用,也可以调用API接口或下载到本地部署。它采用了先进的扩散模型技术,在图像质量和文字理解方面都有显著提升。

功能列表

- "文生图功能:输入文字描述,自动生成对应图像"

- "分辨率调整:支持多种输出尺寸和画质"

- "风格控制:可选择不同的艺术风格"

- "批量生成:一次生成多张图片"

- "API接口:支持开发者集成到自己的应用中"

<li"图像编辑:基于现有图像进行修改和优化"

使用帮助

在线使用

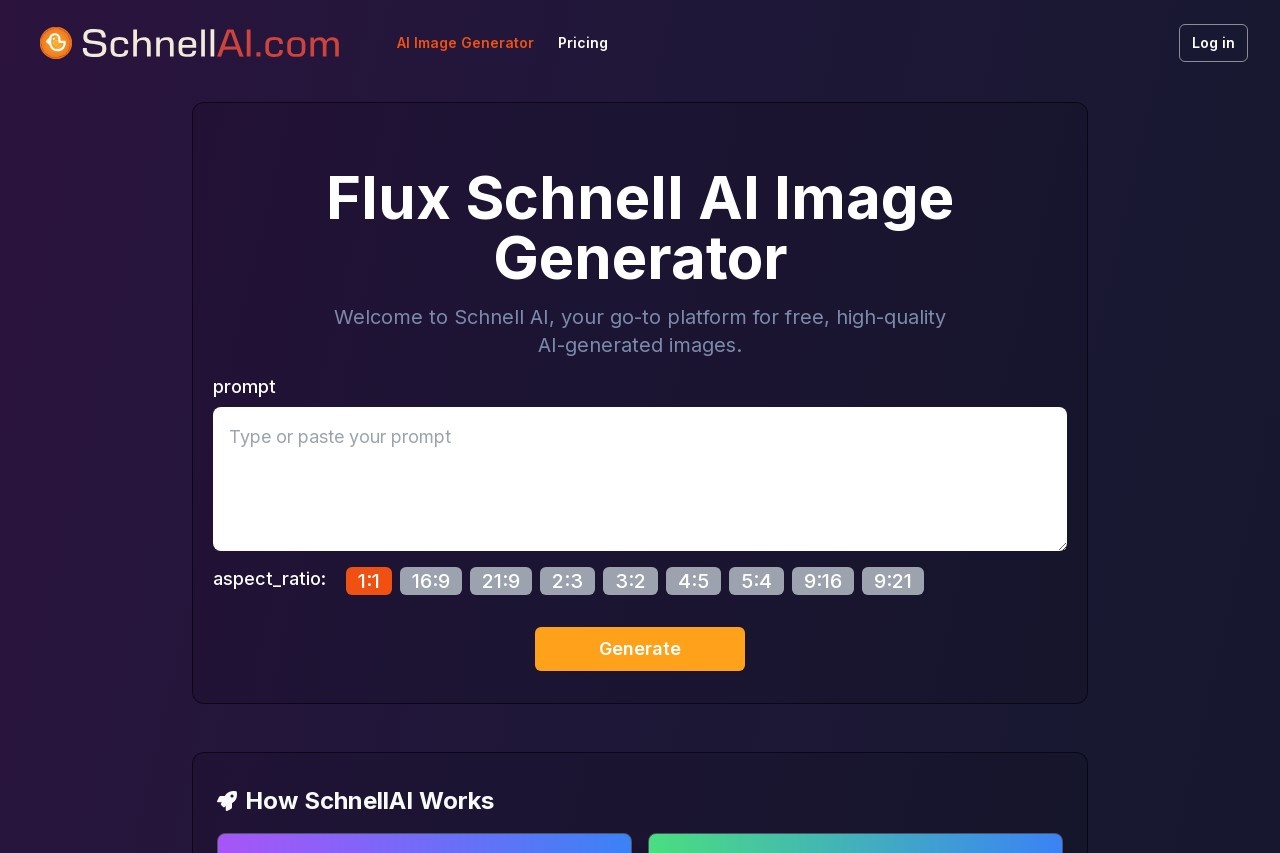

访问Stability AI官方网站。在首页找到Stable Diffusion 3的入口。点击进入后可以看到一个文本输入框。在这里输入你想要生成的图像描述。描述越详细,生成的图像越符合预期。

输入描述后,选择图像尺寸。建议初学者使用默认尺寸。然后点击生成按钮。系统需要一些时间来处理你的请求。等待期间可以看到进度提示。

生成完成后,图片会显示在右侧。如果对结果不满意,可以调整描述词重新生成。也可以点击下载按钮保存图片。

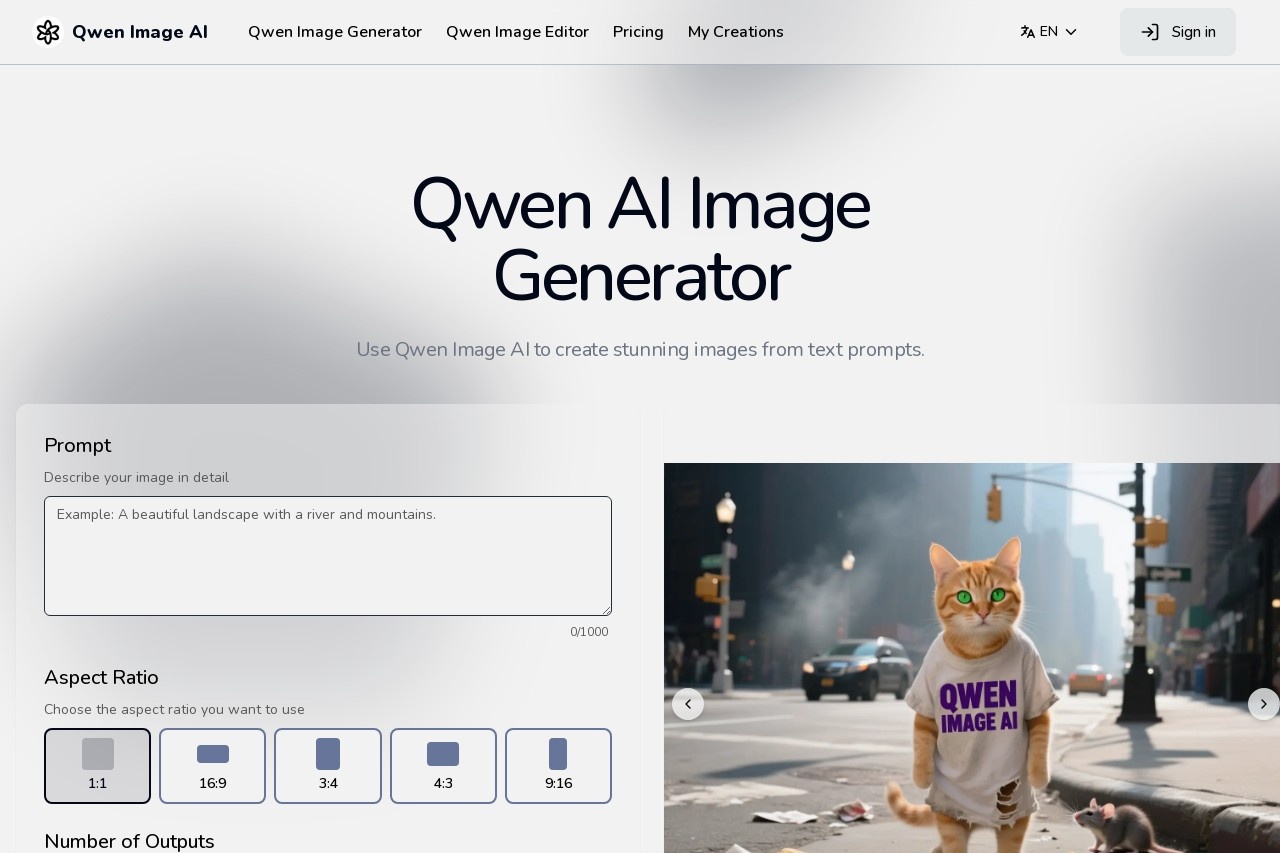

参数设置

高级用户可以使用更多参数。采样步数影响图像质量。步数越多,细节越丰富,但生成时间也越长。建议设置在20-50步之间。

引导尺度控制图像与文本的匹配程度。数值越高,图像越贴近文字描述。但过高可能导致图像失真。推荐使用7-10的数值。

随机种子可以复现相同的生成结果。如果得到满意的图像,记下种子值,下次使用相同种子可以获得相似效果。

API使用

开发者可以申请API密钥。首先注册开发者账号。然后进入控制台创建新项目。获取API密钥后,就可以调用生成接口。

API请求需要包含提示词和参数。返回的是图像数据或下载链接。建议先测试小尺寸图像,确认效果后再生成大图。

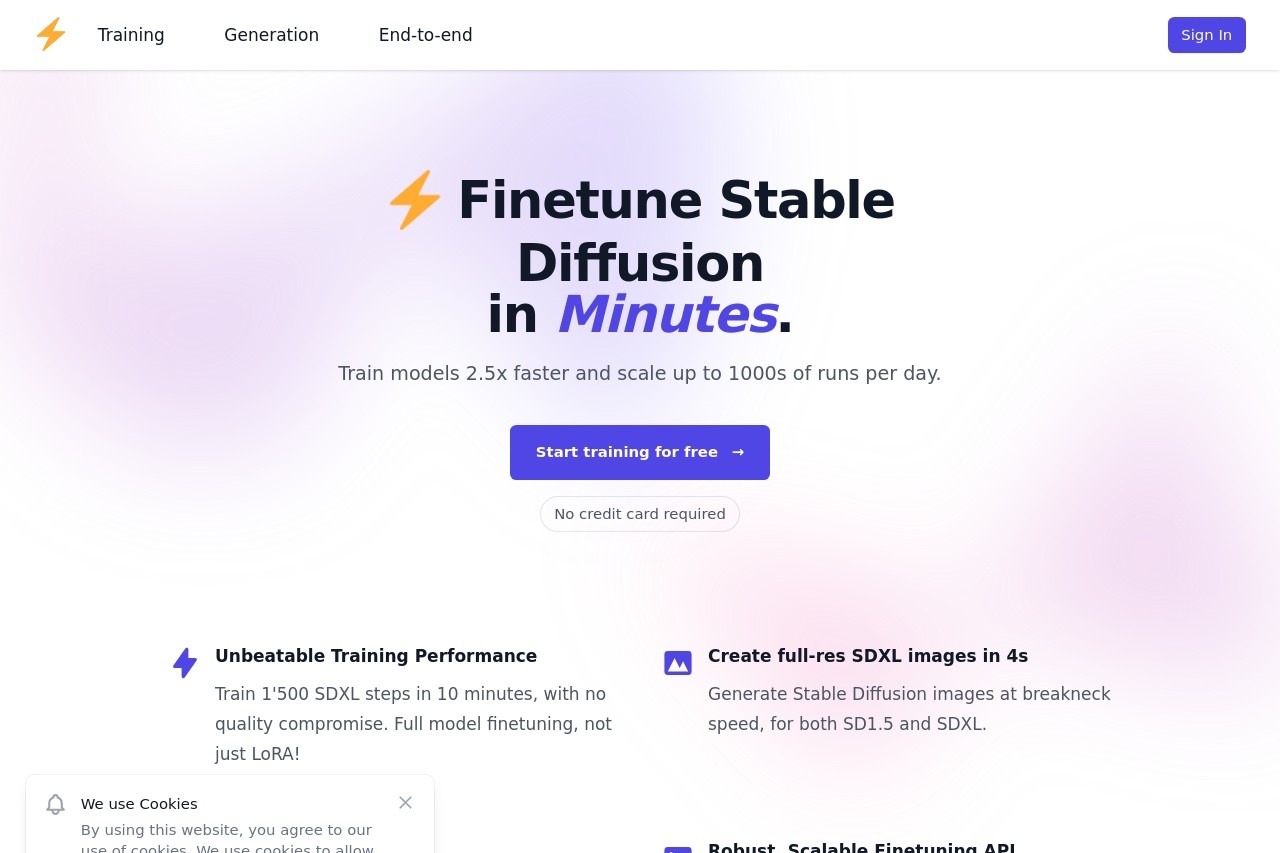

本地部署

技术用户可以选择本地部署。首先下载模型文件。需要准备具有足够显存的显卡。安装Python环境和必要的依赖库。

配置完成后,运行启动脚本。本地部署可以完全控制生成过程。也能保护隐私,所有数据都在本地处理。

建议定期更新模型,以获得最新功能和优化。

产品特色

这是一个能够理解复杂文字描述并生成高质量图像的智能工具。

适用人群

- 设计师:需要快速生成创意素材和设计概念

- 内容创作者:为文章、视频制作配图和封面

- 开发者:希望将AI图像生成集成到自己的应用中

- 艺术爱好者:想要探索数字艺术创作的新方式

应用场景

- 创意设计:为广告、海报生成创意图像

- 内容制作:为博客、社交媒体创建配图

- 概念可视化:将抽象想法转化为具体图像

- 教育演示:制作教学材料和演示文稿插图

常见问题

- 生成图片需要多长时间? 在线生成通常需要30秒到2分钟,具体取决于图像尺寸和服务器负载。

- 可以商用生成的图片吗? 需要查看具体的使用条款,部分生成图片可以商用,但建议仔细阅读授权协议。

- 如何提高生成图片的质量? 使用详细具体的描述词,选择合适的参数设置,多次尝试优化提示词。

- 支持中文描述吗? 支持多种语言,包括中文,但英文描述通常效果更好。